Neugier und Skepsis - epd medien

22.05.2025 07:57

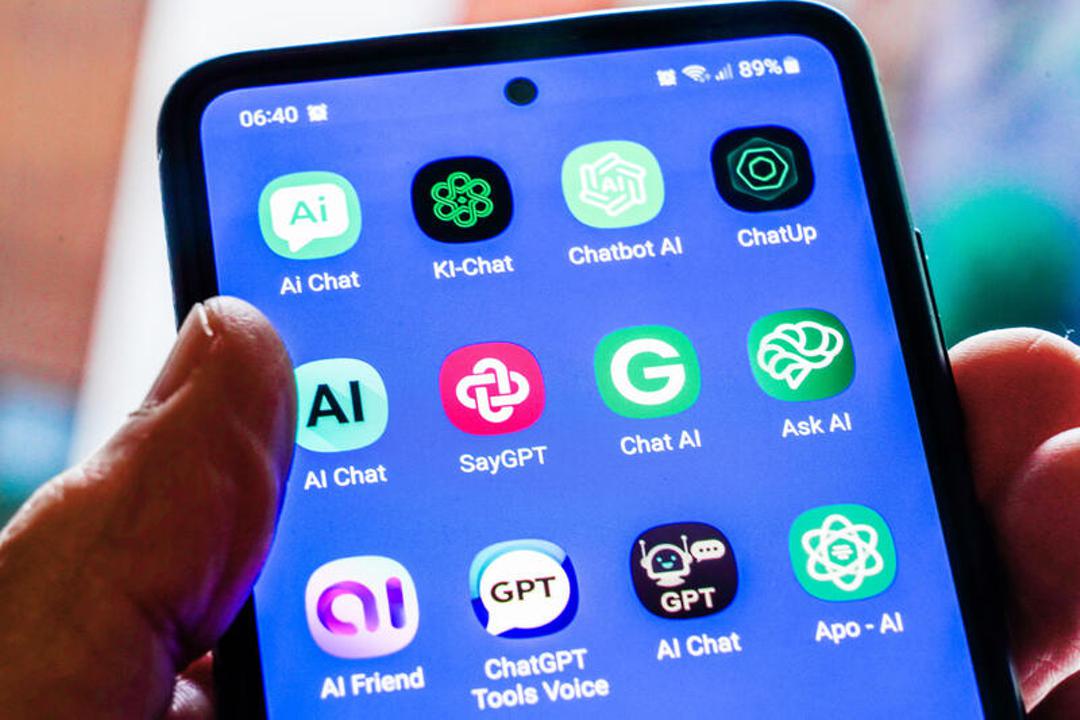

Wie KI für die Informationssuche genutzt wird

epd Kaum ein technologisches Thema sorgt derzeit für so viel Aufsehen wie Künstliche Intelligenz (KI). Seit der KI-Chatbot ChatGPT im November 2022 veröffentlicht wurde, hat sich die gesellschaftliche Aufmerksamkeit schlagartig auf sogenannte generative KI-Anwendungen gerichtet. Dabei wird bereits seit den 1950er Jahren über die Möglichkeiten und Grenzen von KI diskutiert und philosophiert.

Es gibt allerdings relevante Unterschiede zwischen heutiger generativer KI und ihren technologischen Vorgängern. Frühere KI-Systeme, wie etwa Programme zur Erkennung von Mustern in Bildern oder zur Unterstützung bei der Krebsdiagnose, waren darauf spezialisiert, sehr konkrete Aufgaben zu lösen. Sie wurden gezielt für einen bestimmten Zweck entwickelt, zum Beispiel um Röntgenbilder auf Tumore zu analysieren. Diese Systeme arbeiteten im Hintergrund, waren also nicht direkt als KI sichtbar oder interaktiv nutzbar.

Chancen und Risiken

Nun treten Nutzende selbst mit generativen KI-Anwendungen wie ChatGPT, Midjourney, oder Google Gemini in Kontakt. Auf Basis einfacher Eingaben und unter Rückgriff auf gigantische Datenmengen, mit denen die generative KI trainiert wurde, können neue eigenständige Inhalte wie Texte, Bilder, Videos oder Musik generiert werden. Damit eröffnen sich vielseitige Anwendungsbereiche. Im Kontext der Informationsbeschaffung ist der neue Wissenszugang mit Chancen, aber auch mit Risiken verbunden.

Eine Chance ist, dass generative KI Inhalte individuell auf die Nutzerinnen und Nutzer zuschneiden kann. Die Bedienung ist einfach, Fragen lassen sich in Alltagssprache stellen, und Rückfragen sind jederzeit möglich. Das senkt die Einstiegshürde, macht die Technologie für viele Menschen zugänglich - und genau das macht den Reiz aus. Der dialogbasierte Ansatz hilft besonders dann, wenn es um komplexe Themen geht. Anders als bei klassischen Medien (Print, Fernsehen), die keine Rückfragen ermöglichen, kann ein Austausch mit Programmen wie ChatGPT gezielt Abhilfe schaffen. Wer etwas nicht versteht, kann also direkt nachhaken und bekommt eine Erläuterung.

infobox: Eva Luise Knor und Michael Reiss forschen am Hamburger Leibniz Institut für Medienforschung - Hans-Bredow-Institut zu politischer Kommunikation, Nachrichtenkonsum und der Nutzung von Künstlicher Intelligenz für die Informationssuche. Das Arbeitspapier "Zwischen Neugier und Skepsis: Nutzung und Wahrnehmung generativer KI zur Informationssuche in Deutschland" entstand in Zusammenarbeit mit Ezra Stöwing, Lisa Merten und Judith Möller.

Das ist ein großer Gewinn gegenüber klassischen Formaten wie der "Tagesschau" oder einem Zeitungsartikel. Während ein Zeitungsartikel beispielsweise nur berichtet, dass die Europäische Zentralbank den Leitzins erhöht hat, kann man ChatGPT direkt fragen, was das für den eigenen Kredit bedeutet, und erhält eine verständliche, individuelle Antwort. Zudem musste man für verschiedene Themen wie Nachrichten, Kochrezepte oder technische Anleitungen bisher verschiedene Quellen auf- und durchsuchen. Generative KI bündelt all das in einer einzigen Anwendung.

Den Chancen stehen aber auch Risiken gegenüber. Besonders kontrovers diskutiert wird die Anfälligkeit von generativer KI, überzeugend klingende, aber inhaltlich fehlerhafte oder verzerrte Antworten zu generieren. Hierfür gibt es zwei Hauptursachen, die damit zusammenhängen, wie generative KI technisch funktioniert.

Plausibel klingende Fehler

Textbasierte KI-Modelle wie ChatGPT von OpenAI nutzen riesige Textmengen, um Muster und statistische Zusammenhänge zwischen Wörtern und in Texten zu erkennen. Sie berechnen die Wahrscheinlichkeit, mit der bestimmte Wörter aufeinanderfolgen, und generieren daraufhin Antworten. Wenn die Trainingsdaten Fehler oder Verzerrungen enthalten, können diese in den generierten Antworten übernommen werden. Wenn alle Trainingsdaten, auf denen eine generative KI basiert, zum Beispiel konsistent die Behauptung enthielten, dass Bananen blau seien, dann würde die generative KI diese Aussage reproduzieren.

Die andere Ursache für Fehler basiert darauf, dass eine generative KI versucht, eine plausible Antwort zu geben, obwohl sie keine gesicherten oder aber mehrdeutige Informationen zu einer Frage hat. Solche erfundenen Antworten werden auch als "Halluzinationen" bezeichnet und leider sind KI-Modelle bislang so entwickelt und kalibriert, dass sie diese Unsicherheiten nicht offen kommunizieren.

Für die Nutzenden generativer KI sind diese Fehler problematisch, weil ihnen oft das nötige Vorwissen fehlt, um plausibel klingende Fehler als solche zu erkennen. Besonders heikel wird das im Umgang mit sensiblen Informationen wie politischen Inhalten. Während falsche Angaben zur Kochdauer eines Nudelgerichts ärgerlich sind, aber keine schlimmeren Auswirkungen haben als ein verminderter Genuss, können falsche Angaben zu Parteien, Aussagen von Politikern und Politikerinnen, Wahlverfahren oder Gesetzeslagen nicht nur individuelle Meinungen beeinflussen, sondern auch das Vertrauen in demokratische Prozesse untergraben.

Fragmentierung der Öffentlichkeit

So zeigte ein Bericht der Organisationen AI Forensic und AlgorithmWatch, dass generative KI-Anwendungen im Kontext der Landtagswahlen in Bayern und Hessen 2023 wiederholt falsche politische Informationen generierten. Etwa über Hubert Aiwanger, zu dem einige KI-Modelle fälschlich angaben, die Kontroverse um den bayerischen Politiker habe mit Corona-Maßnahmen zu tun und nicht mit den eigentlichen Vorwürfen um antisemitische Flugblätter. Dieses Problem wird umso größer, je verbreiteter und vertiefter auf solche automatisierten Systeme zurückgegriffen wird, um sich zu informieren.

Ein weiteres Risiko generativer KI ist, dass sie bei häufiger Nutzung das kritische Denken schwächen könnte. Vor allem, wenn Menschen sich zu sehr auf die Antworten verlassen, ohne sie zu hinterfragen. Manche warnen auch vor der zunehmenden Fragmentierung der Öffentlichkeit als Risiko der Nutzung generativer KI. Denn obwohl es durchaus vorteilhaft sein kann, dass Inhalte direkt auf die Nutzerinnen und Nutzer zugeschnitten werden, entsteht gleichzeitig die Gefahr, dass Menschen so nur noch formatierte Informationen bekommen, die ihre eigenen Einstellungen verstärken könnten. Hyperpersonalisierte Inhalte könnten so die gemeinsame Wissensbasis schwächen, die für demokratische Aushandlungsprozesse unabkömmlich ist.

Verarmung der Debatte

Besonders kritisch wäre das, wenn generative KI zunehmend journalistische Angebote verdrängen und damit einen Verlust an unabhängiger und originärer Einschätzungs- und Rechercheleistung, einen Qualitätsverlust und eine Verarmung der öffentlichen Debatte nach sich ziehen würde.

Die dargelegten Überlegungen zu den Risiken generativer KI beruhen bislang aber vor allem auf hypothetischen Annahmen und theoretischen Szenarien. Angesichts der raschen Verbreitung der Technologie und der damit verbundenen potenziellen Folgen ist eine umfassende Bestandsaufnahme der tatsächlichen Nutzung unerlässlich, um die Risiken realistisch einschätzen zu können. Neben allgemeinen Erkenntnissen zur Verbreitung sind dabei insbesondere differenzierte Einblicke in verschiedene Nutzungsbereiche wichtig. Denn die Risiken, die mit dem Einsatz generativer KI einhergehen, unterscheiden sich je nach Kontext erheblich.

Am Leibniz-Institut für Medienforschung - Hans-Bredow-Institut haben wir daher im Juni 2024 eine repräsentative Studie in Deutschland durchgeführt, deren Ergebnisse jetzt vorliegen. Wir wollten wissen, ob, wie und von wem generative KI allgemein und insbesondere für politische Informationszwecke genutzt wird. Da diese Fragen und die damit verbundenen Risiken besonders im Zusammenhang mit politischen Wahlen relevant sind, wurde die Europawahl 2024 als Untersuchungszeitraum gewählt. Ziel war, ein möglichst realistisches Bild der Internetnutzenden in Deutschland zu erhalten. Die Zusammensetzung unserer Stichprobe in wichtigen Merkmalen wie Alter, Geschlecht, Bildungsniveau und Wohnort entspricht der Verteilung der Online-Bevölkerung in Deutschland. An unserer Studie haben 1.500 Personen teilgenommen.

Regelmäßige Nutzung noch selten

Ein zentrales Ergebnis der Studie ist, dass rund 44 Prozent der Internetnutzenden in Deutschland bereits Erfahrungen mit generativer KI gemacht haben. Eine regelmäßige Nutzung ist jedoch bei einem Großteil der Nutzenden selten. Das deutet darauf hin, dass generative KI-Anwendungen für die meisten Menschen in Deutschland bisher weder fest etabliert noch in den Alltag integriert sind. Es gibt jedoch Ausnahmen. Junge Menschen nutzen diese Anwendungen besonders häufig im Bildungskontext. Gerade in Schulen, Universitäten und beim Lernen wird generative KI deutlich häufiger genutzt, vor allem von denen, die sich noch in der schulischen oder beruflichen Ausbildung befinden. In dieser Gruppe wird die Technologie von einer Mehrheit mindestens wöchentlich genutzt.

Bei denjenigen, die bereits generative KI nutzen, ist der Hauptgrund dafür Neugier oder generelles Interesse. Für die Gruppe der Nicht-Nutzenden von generativer KI ist der häufigste Grund für die Ablehnung der Technologie ein fehlender Bedarf. Viele Menschen sehen derzeit keinen konkreten Nutzen in generativen KI-Anwendungen und verzichten daher auf ihre Verwendung. Dies deutet darauf hin, dass die Technologie für viele noch nicht als notwendiges oder hilfreiches Werkzeug im Alltag wahrgenommen wird.

Neue digitale Kluft

Es gibt in der Gruppe der Nicht-Nutzenden aber auch Unterschiede bei den angegebenen Gründen, warum sie keine generative KI verwenden. Ältere Menschen, Frauen und Personen mit niedrigerem Bildungsniveau, also Hauptschulabschluss oder vergleichbar, geben häufiger an, dass sie nicht wissen, wo sie generative KI nutzen können, wie sie funktioniert oder wie man sie bedient. Dies könnte auf eine entstehende digitale Kluft hindeuten zwischen Personen, die generative KI nutzen und möglicherweise von den Chancen profitieren, und solchen, die die Technologie gerne nutzen würden, es mangels notwendigen Wissens oder Fähigkeiten aber nicht können.

Für eine erfolgreiche und umfassende Integration generativer KI in den Alltag und damit auch die Nutzung der mit dieser Technologie verbundenen Chancen sollte dieser Umstand genau beobachtet werden: Es geht nicht nur um die bloße Verfügbarkeit der Technologie an sich, sondern auch um das notwendige Wissen und die Fähigkeiten, diese zu nutzen.

Die Studie zeigt, dass generative KI von den meisten Menschen nur selten oder gar nicht für politische Informationen genutzt wird. Auch bei einer Differenzierung nach verschiedenen Nutzungskontexten, zum Beispiel für allgemeine politische Informationen, aktuelle Ereignisse, als Ersatz für Nachrichten oder im Hinblick auf die Europawahl, zeigen sich kaum Unterschiede. Auch demografische Faktoren und andere Merkmale, die mit der Nutzung von generativer KI zusammenhängen, haben nur einen geringen Einfluss auf eine Nutzung der Technologie für politische Informationen.

Keine Bedrohung für journalistische Angebote

Eine Ausnahme bilden nach bisherigem Kenntnisstand lediglich Nutzende, die kostenpflichtige Premiumversionen der Technologie verwenden. Diese Gruppe nutzt generative KI generell deutlich häufiger und auch seit längerer Zeit. Daraus kann geschlossen werden, dass auch der Konsum politischer Informationen durch und über generative KI-Anwendungen steigen könnte, wenn die Nutzung der Technologie insgesamt weiter zunimmt.

Ein weiteres zentrales Ergebnis der Studie zeigt, dass die Nutzung von generativer KI als Nachrichtenquelle bislang keine erhebliche Bedrohung für traditionelle journalistische Angebote darstellt. Stattdessen zeigt sich, dass Personen, die generative KI als Ersatz für Nachrichtenquellen verwenden, auch klassische Quellen für politische Informationen überdurchschnittlich nutzen. Generative KI ist momentan also vor allem eine Ergänzung von etablierten Informationsquellen und löst diese nicht ab.

Momentaufnahme

Hinsichtlich der oben aufgezählten Risiken generativer KI im Kontext politischer Informationen kann aus demokratietheoretischer Perspektive nach bisherigem Stand also Entwarnung gegeben werden: Eine Verdrängung journalistischer Quellen findet nicht statt und die Gefahr, dass Menschen falschen KI-generierten politischen Informationen aufzusitzen, ist gering, da die Technologie einerseits kaum in diesem Kontext (und auch generell selten) genutzt wird und andererseits neben der generativen KI auch meist andere Informationsquellen verwendet werden.

Die Studie bildet jedoch nur eine Momentaufnahme ab. Diese sollte in Zukunft regelmäßig überprüft werden. Sowohl die technische Weiterentwicklung generativer KI als auch ihre Einbindung in unterschiedliche Anwendungsbereiche sind noch in den Kinderschuhen. Die zunehmende Verbreitung in verschiedensten Lebensbereichen (wie neuerdings die Integration einer generativen KI in Whatsapp) sowie der fortlaufende Veränderungs- und Lernprozess im menschlichen Umgang mit dieser Technologie machen verlässliche langfristige Prognosen unmöglich.

Förderung von kritischem Denken

Um eine informierte und demokratische Öffentlichkeit zu erhalten, ist es ratsam, gezielte Maßnahmen zur Förderung von Medienkompetenz und kritischem Denken zu ergreifen, um den verantwortungsvollen Umgang mit diesen neuen Technologien zu fördern.

Generative KI wird also bislang noch sehr selten für politische Informationszwecke genutzt. Zwar zeigt sich, dass ein gewisser Anteil der Bevölkerung bereits heute auf diese Technologien zugreift, doch ist die Technologie für die meisten noch nicht zu einem festen Bestandteil der täglichen Informationsbeschaffung geworden. Eine breitere Akzeptanz der Technologie könnte vor allem mit einer intensiveren Nutzung in anderen Bereichen wie Bildung und Arbeitswelt, einhergehen. Die wachsende Verbreitung generativer KI und ihre zunehmende Integration in verschiedene Lebensbereiche erfordern jedoch eine fortlaufende Auseinandersetzung mit den damit verbundenen Chancen und Risiken, insbesondere im Hinblick auf die Wahrung einer informierten und demokratischen Öffentlichkeit.

Zuerst veröffentlicht 22.05.2025 09:57

Schlagworte: Medien, Internet, Künstliche Intelligenz, KI, Nachrichtennutzung, Mediennutzung, Knor, Reiss, Medienforschung, Studien, HBI

zur Startseite von epd medien